تخيل أنك ترسل صورة طبية للذكاء الاصطناعي، فيحللها ويقرأ التقرير الطبي ويستمع لصوت المريض ويخرج بتشخيص دقيق. هذا ليس خيالاً علمياً — بل هو الذكاء الاصطناعي متعدد الوسائط (Multimodal AI) في 2026.

ما هو الذكاء الاصطناعي متعدد الوسائط؟

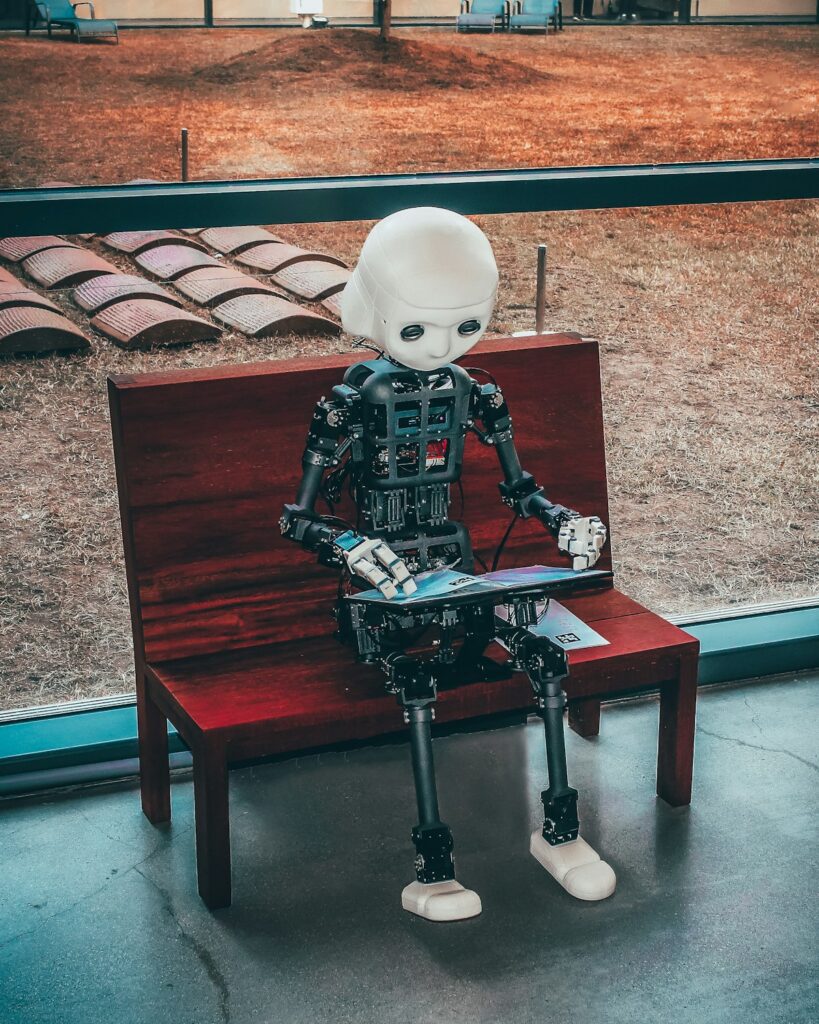

النماذج التقليدية كانت تتخصص في نوع واحد من البيانات: إما نص أو صور أو صوت. أما الذكاء الاصطناعي متعدد الوسائط فيدمج كل هذا معاً في آن واحد، محاكياً طريقة إدراك الإنسان للعالم من حوله.

أبرز 5 مواضيع ترند حوله في 2026

1. التشخيص الطبي المدمج

تستطيع الأنظمة اليوم دمج صور الأشعة السينية والرنين المغناطيسي مع السجلات الطبية وصوت المريض، مما يمنح الطبيب فهماً شاملاً لم يكن ممكناً من قبل. دراسات IBM أثبتت أن هذا النهج يرفع دقة التشخيص بنسبة 35%.

2. محركات البحث المتعددة الوسائط

بات بإمكانك إرسال صورة لمنتج مع كتابة “أريد نفس الطراز بلون مختلف” للحصول على نتائج دقيقة جداً. Google Lens وGPT-4o هما أبرز مثالين حالياً.

3. المساعدون الأذكياء متعددو الوسائط

مساعدون ذكاء اصطناعي جدد قادرون على فهم أسئلتك المنطوقة، وتحليل ما تراه كاميراتك، والرد بطريقة طبيعية. Gemini Live وApple Intelligence مثالان حيان على هذا.

4. تحويل النص إلى فيديو (Text-to-Video)

نماذج مثل Sora من OpenAI وVeo من Google تحولت صناعة المحتوى رأساً على عقب. إنشاء فيديو احترافي من جملة نصية في ثوانٍ — هذا ما تتيحه هذه التقنية في 2026.

5. التعليم التكيفي متعدد الوسائط

أنظمة تعليمية تجمع النصوص والفيديوهات والتجارب التفاعلية لتقديم تجربة تعليمية شخصية بالكامل. وبهذا تختفي الحواجز الجغرافية أمام تعلم المهارات التقنية.

لماذا يهمك هذا الموضوع الآن؟

وفقاً لتقرير IBM وSuperannotate، من المتوقع أن ينمو سوق Multimodal AI بمعدل 34% سنوياً حتى عام 2030. الشركات التي تدمج هذه التقنية اليوم ستلتهم بشكل لا يمكن تجاهله خلال السنوات القادمة.

المصادر والمراجع

- IBM Research — “Multimodal AI in Healthcare 2026”: ibm.com/research

- Superannotate — “State of Multimodal AI Report 2026”: superannotate.com

- Ultralytics — “Multimodal AI Applications”: ultralytics.com

- AI Portal X — “Multimodal AI Trends”: aiportalx.com

- Splunk — “Understanding Multimodal AI”: splunk.com